请求处理中...

请求处理中...

请求处理中...

请求处理中...

引言

你是否曾经拿着一个绝妙的视频创意,却在面对AI工具时只会写出最朴素的指令——“生成一只猫在房间里走路”?结果出来的画面,猫是从天而降的,房间是歪斜的,镜头是纹丝不动的,整个片段看起来就像监控摄像头拍的日常素材,毫无“电影感”可言。这不是AI不够强,而是你还没有学会用“导演的语言”和AI沟通。

很多人在使用AI分镜生成工具时,陷入了一个常见的误区:把AI当成一个“文字转图片”的傻瓜工具,输入什么都行,出来的画面就听天由命。这种做法被圈内人戏称为“抽卡式创作”——生成十次,能有一张能用的就算运气好了。但实际上,顶尖的AI分镜工具已经可以识别专业电影术语、精确控制景别切换、执行复杂的镜头运动,甚至能够自动完成多镜头叙事结构。问题的关键不在于工具本身,而在于你是否掌握了“结构化运镜思维”。

这套方法其实并不复杂。你不需要成为科班出身的导演,只需要理解几个核心概念——景别是叙事的标点符号,运镜是情绪的流动载体,角色一致性是专业和业余的分水岭。本文将从这三大维度出发,结合实战案例,帮你建立一套从“能生成”到“有质感”的完整AI分镜创作体系。文章将依次展开:前置准备中的工具与思维准备,核心步骤里的景别设计、运镜控制与提示词工程,常见踩坑指南,以及进阶的组合技巧。读完这篇,你也能像导演一样“调度”AI。

前置准备

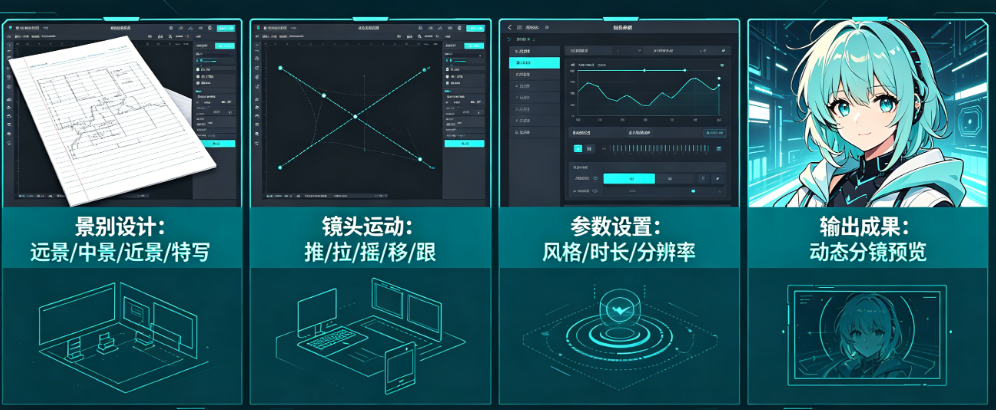

在你打开任何AI分镜工具之前,请先完成两方面的准备。第一是工具层面的准备。一套完整的AI分镜创作流程通常会用到三类工具:剧本/分镜生成类工具(如DeepSeek、ChatGPT,用于快速产出文字分镜脚本)、图像生成类工具(如Midjourney、Lovart、Seedream,用于生成高质量分镜图)、视频生成类工具(如可灵、PixVerse、Seedance,用于让静态分镜“动”起来)。有些平台如Lovart已经实现了“全家桶”式的一站式服务,在一个界面内可以调用多个模型完成从分镜图到视频的全流程。PixVerse V5.5甚至实现了“分镜+音频”一键生成,是国内首个具备完整叙事能力的AI视频模型。

第二是思维层面的准备。你需要建立“分镜思维”——把一段连续的动作拆解成若干关键画面,并为每个画面想清楚三个问题:这个画面离角色多远(景别)?摄像机在做什么运动(运镜)?这个镜头在这个位置要表达什么情绪(叙事意图)? 正如一位资深教育者所说:“分镜的本质不是画画,而是用画面讲故事。即使你只会画火柴人,只要箭头和标注足够清晰,就能指导整个团队完成拍摄。” 对于AI工具来说也是同样的道理——你不需要会画画,但你需要会“描述”画面。

核心步骤

步骤1:景别设计——用“距离”控制叙事节奏

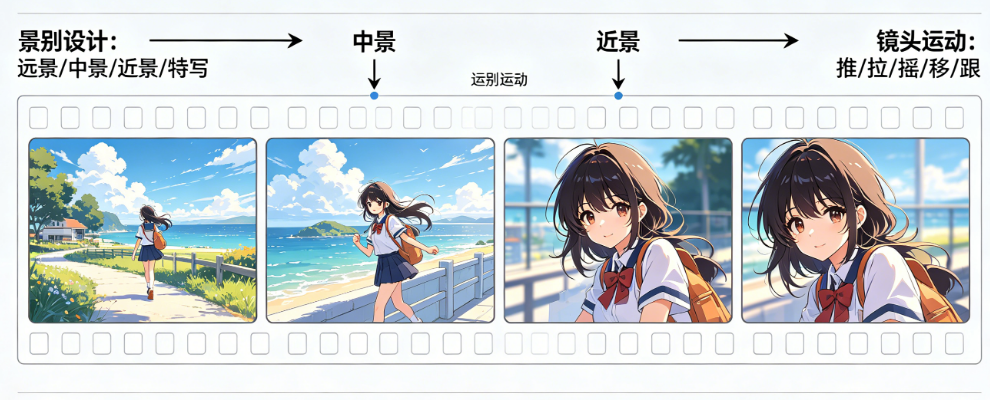

景别是分镜的第一语言,它决定了观众和角色之间的心理距离。在传统影视创作中,景别通常分为六级:极特写、特写、近景、中景、全景、大远景。每一种景别都有其独特的叙事功能,理解它们是在AI提示词中精准控制镜头的前提。

大远景用于“建立世界”,展示角色所处的宏大环境,常出现在故事开场。全景展示角色从头到脚的完整形象,适合交代动作和走位。中景从膝盖或腰部往上,平衡了肢体语言和面部表情,是对话场景的黄金选择。近景从胸部往上,开始进入情绪区域,观众能清晰看到角色的眼神变化。特写聚焦脸部或某个细节,用于强化情绪高潮或强调关键道具。极特写则更加极致,只展示眼睛、嘴唇、或产品Logo的纹理,是“点睛之笔”。

在AI提示词中调用景别非常简单:直接使用“大远景/极远景(Extreme Wide Shot)”“中景(Medium Shot)”“特写(Close-up)”等专业术语即可。但真正的高级技巧在于设计“景别序列”——也就是镜头之间的切换节奏。一个经典的开场序列是“大远景→中景→特写”:先用大远景展示城市全貌建立空间感,再用中景引入角色在街边行走,最后用特写捕捉他紧张的眼神,观众的情绪就被一步步拉入了故事。另一个常用手法是“特写→拉远至全景”,常用于悬念揭示——先让观众看到一个细节(比如地上的血迹),然后缓缓拉远展示全场(原来是一场激烈的搏斗现场)。

步骤2:运镜控制——让摄像机“活”起来

静态的景别决定了“在哪里看”,而运镜决定了“怎么看这个变化的过程”。如果说景别是照片,运镜就是电影。控制和描述运镜是在AI分镜提示词中实现“电影感”的关键。

基础的运镜类型有7种:推镜(摄像机靠近主体,强调细节)、拉镜(摄像机远离主体,揭示环境)、横摇(摄像机左右转动,展示空间)、竖摇(摄像机上下转动,角色登场或仰望)、环绕(摄像机围绕主体运动,立体展示)、跟拍(摄像机跟随主体移动,营造沉浸感)、固定机位(摄像机不动,适合对话或纪实风格)。值得庆幸的是,主流的AI视频工具如Seedance对这些术语的识别率非常高,你只需要在提示词中写出“缓慢推近/推至特写”“稳定跟拍”“轻微环绕”等描述,模型就能准确执行。

进阶的运镜技巧在于“组合”而非单一使用。最经典的结构是“推近→环绕→拉远”:推近让观众注意到主体,环绕让主体立体起来,拉远把主体放回环境中收尾,这个三段式结构在商品展示视频中几乎是万能公式。更高级的电影级运镜术语如“希区柯克变焦(Dolly Zoom)”——通过同时推拉摄像机并调整焦距,制造出一种“空间扭曲感”,非常适合表现角色的眩晕或顿悟时刻;“一镜到底(One-shot)”全程不切镜,依靠精密的摄像机运动完成场景转换;还有“荷兰角(Dutch Angle)”通过倾斜构图制造不安和紧张氛围。但需要注意,专业术语在提示词中适量使用即可,一场对话中出现大量专业术语反而可能让AI生成不协调的结果。

步骤3:分镜生成工作流——从单图到九宫格

当你掌握了景别和运镜的基础知识后,就可以开始实操了。目前最高效的AI分镜生成工作流是“九宫格法”,这个方法尤其适合没有专业分镜绘制经验的普通创作者。

九宫格法的核心操作分为三步。第一步,让AI生成一张3行3列的九宫格分镜图,这张图包含了9个关键画面的缩略图。在生成时,你需要为每个格子指定景别和内容,例如“第一格:大远景,城堡矗立在山巅;第二格:中景,骑士整装待发……第九格:特写,剑鞘上反射出阳光”。第二步,将这张九宫格图作为参考输入到视频生成工具中,使用提示词如“参考@这张九宫格图,按从左到右、从上到下的顺序演绎,保持风格一致,运镜以缓慢推拉为主”。第三步,工具会根据九宫格的构图自动生成连贯的视频片段,实现“一张图生成一段叙事视频”。

另一种更智能的工作流是从“单图到多角度扩散”。Higgsfield推出的Shots功能就是这种思路的典型代表——你上传一张图片,AI会自动分析其中的主体和构图,生成一张3x3的网格图,为你提供广角、特写、过肩、低角度、高角度等9个最有用的机位。这种方式特别适合需要保持角色一致性的场景。Lovart也提供了类似的功能,并且允许你对生成的分镜进行二次编辑,用“改为近景”“改为侧后方视角”等指令调整细节。

常见问题与避坑指南

坑一:忽视角色一致性。 这是AI分镜中最常见也最令人头疼的问题。同一个主角,第一帧是黑发,第二帧变成了棕发;第一帧穿着蓝色外套,第三帧变成了红色。当前的主流解决方案包括:使用Midjourney的CREF(角色参考)功能,上传多张同一角色的图片作为参考;在提示词中固定角色的关键特征描述(“黑色短发、蓝色眼睛、穿着灰色卫衣”);或者利用Shots等工具从一张图扩散出多角度,从根本上保证角色身份的一致性。

坑二:景别混乱,叙事不连贯。 新手常犯的错误是没有明确区分景别,导致画面之间跳跃感强。解决办法是使用“景别序列”思维:每一组连续镜头都应遵循某种逻辑,比如从大到小(全景→中景→特写)建立情绪递进,或从小到大(特写→中景→全景)揭示更大画面。在提示词中明确写出每个镜头的景别,而非只描述内容。

坑三:忽略分镜的“技术文档”属性。 很多创作者把分镜当成“美丽的画”,画得美轮美奂却忽略了“可操作性”。分镜本质上是指导拍摄或生成的技术文档,它的价值在于“传递信息”。在AI分镜中,这意味着你需要标注清楚:每个镜头的景别是什么?运镜方向用箭头标示了吗?转场方式是硬切还是叠化?这些信息远比画面的精美程度更重要。

进阶技巧与额外提示

掌握了基础操作之后,下面这几个进阶技巧能让你的AI分镜输出品质再上一个台阶。

第一,用SSML和标注语言精细控制。虽然不是所有AI视频工具都支持,但领先的平台已经允许使用类似标记语言的方式来控制镜头。在提示词中精确标注时间节点是一种非常有效的方式,例如“0-4秒:特写推近,聚焦手部动作;5-9秒:环绕展示,360度呈现产品;10-13秒:拉远至全景,展示使用环境”。这种“分时段标注法”能让AI的运镜节奏更加合理。

第二,利用不同模型的优势做组合。没有一款模型在所有维度上都是最强的。一种被验证有效的工作流是:用Midjourney生成高质量的角色和场景图(它的美学天花板目前无人能及),用Seedream或Lovart做基于原图的多角度扩散和景别调整(它们擅长一致性和延展),最后用可灵或PixVerse做视频化生成。把模型当成“团队成员”而非“万能工具”,组合使用往往能得到1+1>2的效果。

第三,用Sref Code锁定审美风格。如果你希望保持系列作品的美学一致性,Midjourney的Sref Code是一个非常强大的工具。这些代码可以在网络上的资源网站上找到现成的,也可以自己训练。在提示词末尾加上“--sref 3171847554”,就可以让AI沿袭这一风格代码所代表的视觉特征。

常见问答

问:我是一个完全不懂摄影的新手,也能学会AI分镜吗?

答:完全可以。你不需要会画画,也不需要懂复杂的摄影术语。只需要记住几个核心概念——景别(远全中近特)、基础运镜(推拉摇移跟)、以及“180°轴线原则”,剩下的都可以交给AI。很多专业导演也是从模仿开始学起的,建议先找一段喜欢的视频,逐帧分析它的景别和运镜,然后尝试用AI复现。

问:哪个AI分镜工具最好用?

答:取决于你的需求。如果追求极致的图像质量和美学,Midjourney是不二之选。如果需要一站式工作流(从分镜图到视频),Lovart和PixVerse V5.5非常方便。如果追求运镜的精准控制,Seedance对专业术语的识别率很高。建议每个工具都利用免费额度试用一下,然后建立自己的“工具组合包”。

问:AI分镜能直接用于商业项目吗?

答:可以,但需要经过筛选和二次处理。AI生成的图像和视频中可能出现细节瑕疵(手指数量错误、衣物纹理不一致等),建议用高清放大功能(如Upscale)提升画质后,再用后期软件做简单修复。对于角色一致性问题,建议先生成完整的九宫格参考图,确保各个角度的特征统一,再进行批量生成。

总结

AI分镜生成不是“文字转图片”那么简单,它是一门需要学习的“导演语言”。从理解景别的叙事意义,到精准调用运镜术语,再到建立九宫格或多图扩散的工作流,每一个环节都是从一个“随机生成的被动使用者”向“稳定产出的主动导演”迈进的一步。回顾整个过程:你用景别控制观众的情绪距离,用运镜赋予画面生命,用组合工作流和一致性技巧保证产出质量。这套方法论是系统性的,它不依赖于某一个具体的工具,而是一种思维框架——无论未来的AI工具如何迭代,只要你掌握了“如何用视觉语言描述想法”的能力,你就永远能驾驭它们。

现在,你可以开始你的第一次AI分镜创作了。选择一个你喜欢的工具,从一张图或一个简单的故事开始,尝试生成第一个九宫格分镜图。你会发现,当你的脑子里的“电影”第一次变成屏幕上连续的画面时,那种成就感是单纯“抽卡式生成”永远无法比拟的。

一品威客任务需求发布参考

如果你在学习了AI分镜技巧后,发现自己虽然有创意和脚本,但实际执行起来仍然耗时费力,或者你需要为某个大型项目批量产出高质量分镜图,那么将部分工作外包给专业服务商是一个非常务实的选择。一品威客网可以帮你快速找到合适的人才。你可以在“任务大厅”发布需求,比如“需要将一份30秒的短视频脚本,用Midjourney生成20张高质量分镜图”“寻找擅长Seedance运镜控制的AI视频创作者,制作60秒产品宣传片”“需要Lovart或可灵平台的操作手,批量生成角色一致的动画分镜”——发布时建议附上你的参考图、风格描述和分镜脚本,这样服务商能给出更精准的报价。如果你想看看别人是怎么做的,去“服务大厅”逛逛,很多入驻的设计工作室和AI视频团队会展示他们的分镜案例和最终成片,极具参考价值。在“人才大厅”中,你可以按“AI视频”“分镜设计”“Midjourney”等标签筛选服务商,查看他们的作品集,直接发起沟通。“威客攻略”频道有大量关于“如何验收AI生成内容”“如何制定创意类外包需求”的实用文章,对项目发布者非常友好。如果你有长期、批量的分镜需求,可以考虑“V客优享”会员服务,享受商机优先推送和专属客服支持,大幅提升找人效率。此外,“一品商城”还提供现成的AI提示词模板、分镜表格模板等数字产品,适合需要快速启动项目的团队。一品威客已于2024年登陆纳斯达克,汇聚了数百万专注于文化创意服务的技术和创意人才,能把你的“导演梦”从一个想法变成一套可以落地的执行方案。

价格是多少?怎样找到合适的人才?

¥100 已有0人投标

¥50000 已有0人投标

¥1000 已有0人投标

¥100 已有3人投标

¥1000 已有0人投标

¥800 已有2人投标

¥300000 已有0人投标

¥5000 已有3人投标